Hvordan bruger man AI-stemmer til podcasts?

Gør tekster til tale og læs højt

Gør tekster til tale og læs højt

AI-stemmer er syntetiske taleoutputs genereret fra skreven tekst ved hjælp af AI-stemmegeneratorer. I podcastproduktion giver AI-stemmegeneratorer skabere mulighed for at konvertere manuskripter direkte til talt lyd uden brug af mikrofon eller optagelsessoftware. AI-stemmegenererings-arbejdsgangen begynder med at forberede et tekstmanuskript, vælge en digital stemme fra AI-stemmegeneratorens bibliotek og eksportere lydfilen til redigering eller umiddelbar brug.

AI-stemmegenerering hjælper med at opretholde en ensartet vokal tone på tværs af episoder, understøtter justeringer i tempo og udtale og giver adgang til flere sprog og accenter fra en enkelt grænseflade. Podcastere bruger AI-stemmeværktøjer til at fremskynde produktionstider, kontrollere vokal output med præcision og reducere de samlede produktionsomkostninger.

Efterhånden som det globale podcastmarked fortsætter med at vokse hurtigt, ifølge Fortune Business Insights, adopterer skabere i stigende grad AI-stemmeværktøjer for at imødekomme efterspørgslen efter skalerbar, effektiv indholdsproduktion.

Her er en kort liste, der opsummerer de fem hovedtrin til at bruge AI-stemmer til podcastproduktion.

- Vælg en AI-stemmegenerator: Vælg en AI-stemmegenerator, der tilbyder naturligt lydende stemmer og tilpasningsmuligheder.

- Skriv et podcastmanuskript: Forbered et klart, struktureret manuskript, der matcher podcastens format og tone.

- Tildel stemmer og juster indstillinger: Vælg stemmer til forskellige dele eller karakterer og modificer hastighed, tonehøjde eller følelse efter behov.

- Eksporter og gem lyden: Download den endelige voiceover i et kompatibelt lydformat som MP3 eller WAV.

- Udgiv episoden: Upload lyden til en podcast-hostingplatform eller redigeringssoftware til distribution.

1. Vælg en AI-stemmegenerator

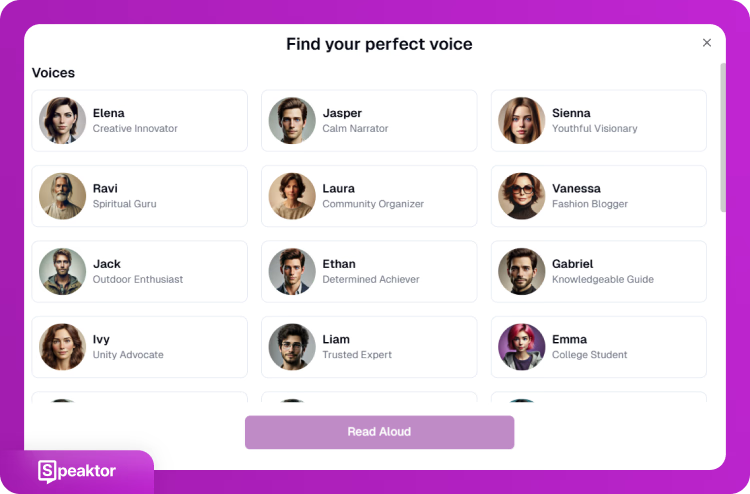

At vælge en AI-stemmegenerator er det første trin i podcastproduktion ved hjælp af syntetisk fortælling. En AI-stemmegenerator skal konvertere tekst til tale med høj klarhed og naturligt tempo. Den valgte AI-stemmegenerator bør give flere stemmevalg, herunder variationer i accent, køn og tone, for at passe til forskellige podcastformater.

Vigtige funktioner at tjekke inkluderer stemmetilpasningsindstillinger (hastighed, tonehøjde, betoning), understøttelse af flere sprog og evnen til at tildele forskellige stemmer til forskellige sektioner. Nogle tjenester, såsom Speaktor, Speechify og Murf AI, tilbyder stemmekloning, hvilket giver skabere mulighed for at replikere specifikke vokale stilarter for brandingkonsistens.

Speaktor, ElevenLabs, Speechify og Murf AI varierer i stemmekvalitet, kontrolfunktioner og eksportformater. Podcastere vælger baseret på projektbehov, såsom flersproget support, kontrol af følelsesmæssig tone eller integration med redigeringsarbejdsgange. Med eMarketer, der forudsiger fortsat vækst i globale podcastlyttere, bliver det stadig vigtigere at vælge en AI-stemmegenerator, der understøtter udvidelse af publikum.

Følgende AI-stemmer til podcast skiller sig ud blandt de tilgængelige muligheder for podcastproduktion.

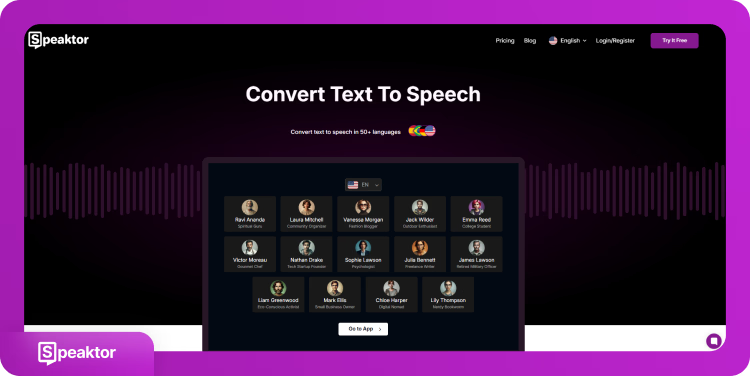

- Speaktor: Speaktor genererer AI-voiceovers på over 50 sprog og 15+ toner med høj nøjagtighed.

- ElevenLabs: ElevenLabs understøtter over 300 stemmer og en intuitiv grænseflade til at strømline podcastskabelsesprocessen.

- Speechify: Funktioner som øjeblikkelige AI-resuméer, stemmekloning og OCR-scanning kan gavne podcastere.

- Murf AI: Murf tilbyder stemmer af høj kvalitet med understøttelse af over 120 stemmer på tværs af mere end 20 sprog.

1.1 Speaktor

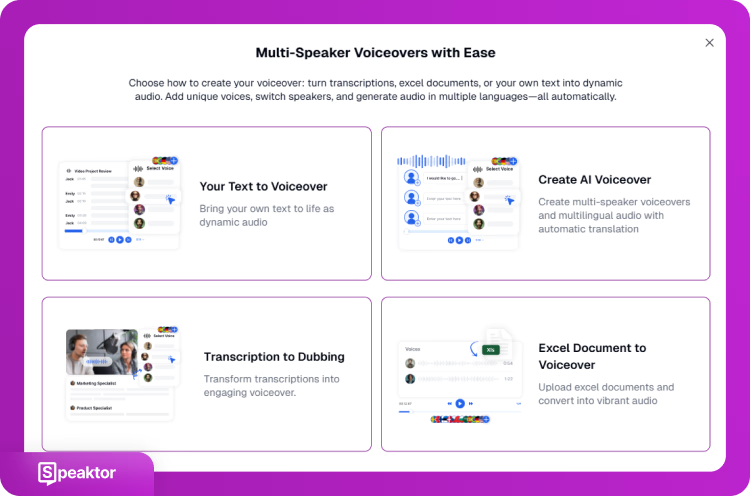

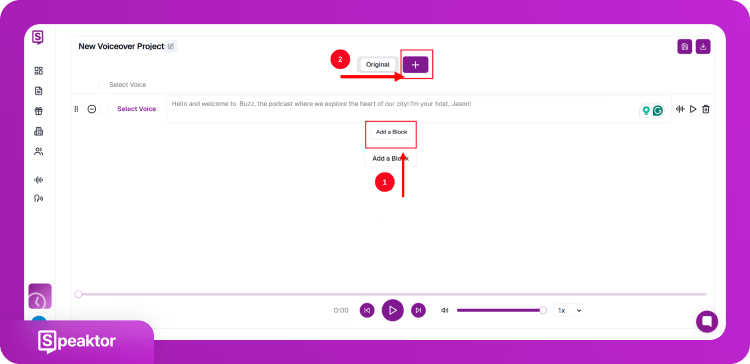

Speaktor er en browserbaseret TTS-generator designet til hurtig stemmeoutput på over 50 sprog. Speaktor tilbyder flere stemmetoner, der passer til forskellige indholdsformater, herunder formel, afslappet og karakterbaseret fortælling. Ud over podcasting understøtter Speaktor forskellige anvendelsesområder på tværs af forskellige brancher og indholdstyper. Brugere kan anvende indstillinger såsom tonehøjde, tempo og strategiske pauser for at forbedre rytme og klarhed i podcast-lyd.

Speaktors interface giver brugere mulighed for at tildele forskellige stemmer til separate dialogblokke, hvilket gør det nyttigt til podcast-formater med flere stemmer. Speaktor understøtter også redigering af manuskripter i realtid og eksport af output i WAV- og MP3-formater. For skabere, der ønsker at strømline hele deres arbejdsgang, tilbyder Speaktor omfattende tekst-til-podcast konvertering funktioner, der forenkler hele produktionsprocessen fra manuskript til færdigt lydindhold.

Fordele:

- Bredt udvalg af sprog og tonelejer

- Intuitiv editor til flere stemmer

- Klar stemmekvalitet med tilpasningsmuligheder

Ulemper

- Begrænset kontrol over følelsesmæssig fremførelse

1.2 ElevenLabs

ElevenLabs tilbyder over 300 stemmemodeller og understøtter stemmekloning til avancerede podcast-anvendelser. ElevenLabs specialiserer sig i at generere udtryksfuld lyd med tonevariation og præcis rytme. Styrken ved ElevenLabs ligger i følelsesmæssig fremførelse, hvilket gør den velegnet til historiefortælling og dramatisk dialog.

ElevenLabs inkluderer en stemmedesign-grænseflade, hvor brugere kan finjustere stemmekarakteristika eller replikere virkelige menneskestemmer. ElevenLabs' brugergrænseflade understøtter flersproget output, selvom generatoren mangler fuld kontrol over timing mellem ord og detaljerede indstillinger for betoning.

Fordele:

- Høj følelsesmæssig realisme

- Omfattende stemmebibliotek

- Stemmekloningsfunktioner

Ulemper:

- Ingen manuel pause- eller tonehøjdetiming

- Let indlæringskurve for tilpasning

1.3 Speechify

Speechify tilbyder et bredt udvalg af stemmeindstillinger på tværs af 60+ sprog. Speechify inkluderer OCR-scanning, AI-genererede resuméer og stemmekloning. Speechifys indbyggede værktøjer understøtter podcastere, der har brug for at konvertere visuelt indhold til talt tekst eller genbruge manuskripter effektivt.

Speechifys kompatibilitet på tværs af enheder sikrer tilpasning til mobile og desktop arbejdsgange. Mens Speechify klarer sig godt til fortælling og resuméer, lyder nogle stemmer ofte kunstige, især i længere lydoutput eller komplekse følelsesmæssige scener.

Fordele:

- Stemmekloning og resuméringsværktøjer

- Kompatibel med alle større platforme

- OCR og visuel-til-lyd input

Ulemper:

- Nogle stemmer lyder syntetiske

- Begrænset fleksibilitet i redigering

1.4 Murf AI

Murf AI leverer præcis TTS-konvertering med over 120 stemmer på 20+ sprog. Murf AI giver kontrol over hastighed, intonation og stemmemæssige pauser, hvilket gør værktøjet velegnet til både solo- og multi-karakter podcasts. Grænsefladen er optimeret for brugervenlighed og kræver minimal teknisk baggrund.

Murf AI inkluderer stemmemærkning til tildeling af roller i manuskripter med flere talere og understøtter eksport i flere formater. Murfs største begrænsning ligger i lejlighedsvise fejludtaler, især for ualmindelige ord eller navne.

Fordele:

- Hurtig stemmetildeling til manuskripter med flere roller

- God tonekontrol og rytme

- Brugervenlig grænseflade

Ulemper:

- Kan fejluttale ikke-standardord

- Færre stemmer sammenlignet med større biblioteker

2. Skriv et podcast-manuskript

AI-stemmer til podcast er helt afhængige af det skrevne manuskript for at generere lyd. Outputtet afspejler de nøjagtige ord, sætningsstrukturer, tegnsætning og formatering, der indtastes i den valgte AI-stemmegenerator. Et klart, struktureret manuskript hjælper med at fastholde lytternes engagement og forhindrer robotagtig eller usammenhængende fremførelse.

Tone refererer til den generelle talestil, såsom formel, afslappet, instruerende eller fortællende. Tempo styrer, hvor hurtigt eller langsomt talen flyder. Manuskriptstruktur refererer til, hvordan indhold er opdelt i segmenter, herunder introduktioner, overgange og afslutninger. Tone, tempo og segmentstruktur skal kontrolleres gennem valg af sætninger, tegnsætning og formatering.

For at forberede et podcast-manuskript til AI-fortælling, følg retningslinjerne nedenfor.

- Definer formatet: Identificer om episoden er en monolog, dialog, interview eller fortællende historie. Strukturer manuskriptet i klare sektioner baseret på dette format.

- Brug korte, direkte sætninger: Undgå lange eller komplekse sætningsstrukturer. Brug klare, fuldstændige sætninger for lettere AI-behandling.

- Inkluder tegnsætning for rytme: Brug kommaer, punktummer og ellipser til at styre stemmens tempo. Tilføj linjeskift mellem afsnit for at indikere pauser.

- Tilføj sammentrækninger hvor det er passende: Skriv naturligt samtalende sætninger (f.eks. “du er” i stedet for “du er”) hvis tonen er uformel.

- Indsæt talermærker til opsætninger med flere stemmer: Mærk hver stemmelinje tydeligt for at tildele den til en specifik AI-stemme i senere trin.

- Markér udtalenoter: Brug parenteser til fonetiske stavemåder eller betoning, hvis TTS-værktøjet tillader manuel inputkontrol.

- Undgå vage eller fyldord: AI-stemmer fortolker præcise input. Fjern unødvendige beskrivelser eller abstrakte udtryk, der kan forvrænge leveringen.

3. Tildel Stemmer og Juster Indstillinger

Når manuskriptet er klart, er næste skridt at tildele stemmer og konfigurere leveringsindstillinger. Stemmen og leveringsindstillingerne former, hvordan indholdet lyder, uanset om tonen er dynamisk, formel, samtalende eller karakterbaseret. Stemmetildeling bliver særligt vigtig for episoder med flere stemmer eller indhold, der inkluderer dialog eller fortællerskift.

Begynd med at tildele forskellige stemmer til forskellige talere eller sektioner. De fleste AI-fortællerværktøjer lader brugerne vælge fra en menu af stemmemodeller og anvende dem på specifikke tekstblokke. Podcastere vælger stemmer baseret på hver talers rolle; langsommere, dybere stemmer passer til autoritative dele, mens lettere toner fungerer bedre til afslappede eller responsive roller.

Brug følgende justeringer til at kontrollere stemmeleveringen.

- Ændr hastighed for at styre tempoet. Langsommere hastigheder fungerer godt til seriøst eller teknisk indhold, mens hurtigere levering passer til energiske eller afslappede emner.

- Juster tonehøjden for at skelne mellem karakterer eller for at ændre tone for forskellige segmenter. En lidt højere tonehøjde kan udtrykke ungdom eller hast; en lavere kan lyde mere afmålt.

- Anvend følelsesmæssige forudindstillinger, hvis værktøjet tillader det (f.eks. rolig, begejstret, vred). Dette giver leveringen mere nuance, især i fortællinger eller dramatiserede segmenter.

4. Eksporter og Gem Lyden

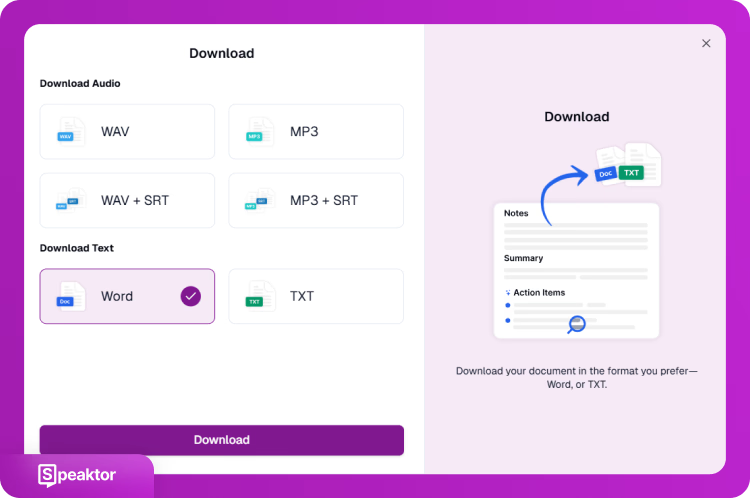

Efter at have tildelt stemmer og indstillet leveringsparametre, er den sidste opgave at eksportere den AI-genererede voiceover til en anvendelig lydfil. Den eksporterede voiceover bliver basen for udgivelse eller yderligere redigering. De fleste AI-stemmegeneratorer giver muligheder for at downloade outputtet i forskellige formater, afhængigt af den tiltænkte brug. For professionelle resultater, brug Adobe Podcast-lydfiltre til at forbedre lydkvaliteten efter eksport.

Fem eksporttrin inkluderer følgende.

- Vælg filformat: Vælg MP3 til generel brug eller WAV til redigering i høj kvalitet. MP3 er komprimeret og fungerer godt til direkte uploads. WAV bevarer fuld lydkvalitet til avanceret efterbehandling.

- Juster lydkvalitetsindstillinger: Indstil bitrate eller samplingsfrekvens som krævet. Højere indstillinger giver klarere lyd, men øger filstørrelsen.

- Download lydfilen: Klik på eksport- eller downloadknappen. Gem filen på din enhed eller cloud-platform til opbevaring og deling.

- Eksporter manuskriptet (valgfrit): Gem det originale manuskript i TXT- eller DOCX-format, hvis værktøjet tilbyder det. Dette hjælper med arkivering eller generering af programnoter og transskriptioner.

- Bekræft afspilning: Lyt til den eksporterede lyd ved hjælp af en medieafspiller. Tjek for udtale, tempo, stemmeskift og pausepræcision. Rediger og eksporter igen, hvis nødvendigt.

5. Optimer til Flersproget og Følelsesmæssig Levering

Forbedring af podcastlevering med flersproget support og følelsesmæssige stemmeindstillinger udvider publikums rækkevidde og forbedrer engagementet. Mange AI-fortællingstjenester tilbyder sprogomskiftning og følelsesforudindstillinger for at matche manuskriptets tone eller målgruppe.

For at forberede indhold til forskellige sprog skal du oversætte manuskriptet ved hjælp af et professionelt oversættelsesprogram eller et integreret sprogmodul. Podcastere vælger en stemme, der matcher sproget og tonen. Sørg for, at den valgte stemme bruger korrekt udtale og rytme for det pågældende sprog, og gennemgå kulturelle vendinger for at bevare klarheden. Ifølge Statista er bekymringer om AI-teknologi stadig betydelige, hvor 74% af amerikanske voksne udtrykker bekymring for databeskyttelse og 63% er bekymrede for gennemsigtighed i træning af AI-modeller. At være transparent om brugen af AI hjælper med at opbygge publikums tillid og adresserer disse legitime bekymringer.

Følgende justeringer styrer, hvordan AI-stemmen udtrykker følelser og leverer indhold på forskellige sprog.

- Vælg en stemme med følelsesforudindstillinger som neutral, begejstret eller seriøs.

- Match følelsesmæssig tone til indholdstype (f.eks. begejstret til meddelelser, rolig til instruktion).

- Finjuster tonehøjde og tempo for at understøtte følelsesmæssig realisme.

Følgende hjælper med at opretholde konsistens og klarhed ved produktion af podcast-lyd til internationale målgrupper.

- Vælg flersprogede stemmer, der passer til regionale dialekter.

- Brug samme struktur og timing i alle versioner for at opretholde konsistens.

- Valider lydoutputtet med indfødte talere, hvis muligt.

Konklusion

AI-stemmer til podcast transformerer podcast-produktion ved at gøre professionel lydkvalitet tilgængelig og effektiv. Succes afhænger af at vælge de rigtige værktøjer som Speaktor, ElevenLabs eller Murf AI, forberede velstrukturerede manuskripter og konfigurere passende stemmeindstillinger. Selvom der eksisterer publikumsbekymringer om AI, opbygger transparent kommunikation om brugen tillid og hjælper skabere med at udnytte disse kraftfulde værktøjer til at imødekomme den voksende efterspørgsel efter indhold.

Ofte stillede spørgsmål

Ja, AI-stemmer bruges i stigende grad til podcasts. De er velegnede til solokommentarer, fortællende historiefortælling, flersprogede episoder og ethvert indhold, hvor konsistent stemmekvalitet er vigtig.

Ja, de fleste AI-stemmeværktøjer tillader kommerciel brug med betalte abonnementer. Tjek altid de specifikke licensvilkår for hver platform, og oplys når du bruger AI-genererede stemmer i dit indhold.

Mange AI-stemmeværktøjer tilbyder transskriptionsfunktioner sammen med stemmegenerering. Du kan også bruge dedikerede transskriptionstjenester eller konvertere din AI-genererede lyd tilbage til tekst ved hjælp af tale-til-tekst-værktøjer.

Eksportér i WAV-format ved 44,1 kHz/16-bit til redigering, og konvertér derefter til MP3 ved 128 kbps eller højere til distribution.